Technologies d'amélioration de la protection de la vie privée : un survol de l'apprentissage fédéré

Par : Julian Templeton, Statistique Canada

Introduction

Les organismes nationaux de statistique (ONS) utilisent les données recueillies pour fournir des renseignements sur divers sujets, dans l'intérêt public. Malgré leur accès à de vastes quantités de données, il y a des limites à ce qui peut être recueilli ou présenté, quels qu'en soient les avantages. Les ONS doivent veiller à ce que les renseignements personnels restent privés, y compris les données diffusées. Au Canada, il existe des lois qui imposent la protection des données confidentielles, et Statistique Canada doit s'y conformer. Lorsque des données de nature délicate sont recueillies, tout le monde n'est pas convaincu qu'elles resteront privées et protégées, ce qui peut amener certaines personnes à hésiter à fournir leurs données.

Afin de renforcer la protection des données dans l'ensemble du secteur public et de permettre de nouvelles possibilités de collecte, de partage et d'utilisation des données, divers ONS explorent activement des moyens innovants d'utiliser et de recueillir des données de manière privée. Les technologies d'amélioration de la protection de la vie privée ou technologies liées à la protection de la vie privée (TPVP) constituent un nouvel ensemble de techniques actuellement à l'étude (voir : Une brève enquête sur les technologies liées à la protection de la vie privée).

Il existe de nombreux types de techniques d'amélioration de la protection de la vie privée, dont les suivantes.

- Apprentissage fédéré : Permet de construire des modèles d'apprentissage automatique (AA) à partir de données distribuées, qui restent sur l'unité périphérique d'un client et ne sont pas recueillies. Les clients utilisent leurs données et leur unité périphérique pour entraîner des modèles d'AA locaux, qui sont ensuite recueillis et compilés dans un modèle central. Il s'agit d'un sous-ensemble de l'AA distribué, et nous en parlerons plus en détail dans le présent article.

- Chiffrement homomorphe : Permet d'effectuer des opérations mathématiques sur des données chiffrées afin de préserver la protection de la vie privée pendant l'utilisation des données. Pour en savoir plus à ce sujet, voir le récent article du Réseau de la science des données : Technologies liées à la protection de la vie privée partie deux : introduction au chiffrement homomorphe.

- Environnements d'exécution de confiance : Environnements virtuels isolés, également appelés enclaves sécurisées, qui peuvent exécuter du code sans être accessibles ailleurs.

- Confidentialité différentielle : Ajoute du bruit aux données afin que des modifications puissent leur être occasionnellement apportées. Cela permet de protéger les données et de fournir un déni plausible, de sorte qu'une seule entrée de données peut avoir été modifiée par rapport à son état initial. La suppression d'un seul échantillon de formation de l'ensemble d'apprentissage ne devrait pas avoir d'incidence sur les résultats globaux.

- Calcul sécurisé multi-parties : Permet à deux parties ou plus d'exécuter conjointement et en toute sécurité des fonctions sur leurs données.

Toutes les techniques d'amélioration de la protection de la vie privée énumérées ci-dessus offrent une méthode unique d'amélioration de la protection de la vie privée. Cependant, chaque technique présente ses propres inconvénients et doit être sélectionnée en fonction du cas d'utilisation dérivé. Bien qu'aucune technique d'amélioration de la protection de la vie privée ne soit une solution universelle aux problèmes de protection de la vie privée, différentes techniques peuvent être utilisées en conjonction les unes avec les autres pour assurer une meilleure protection de la vie privée dans l'ensemble. Statistique Canada est en phase de recherche sur les techniques d'amélioration de la protection de la vie privée. Il devient évident que l'adoption généralisée de techniques d'amélioration de la protection de la vie privée dans les secteurs public et privé sera nécessaire à mesure que la confidentialité des données deviendra plus courante et que de nouvelles lois sur la confidentialité des données seront adoptées.

L'une des méthodes d'exploration des statistiques consiste à utiliser des modèles d'AA, qui visent à apprendre des modèles par l'intermédiaire des données et à fournir des données de sortie cibles. Différents ONS utilisent déjà ou commencent à utiliser l'AA pour soutenir les processus internes, alléger la charge des analystes et améliorer l'efficacité globale. L'un des défis de l'AA est que la qualité des données utilisées est importante pour obtenir un modèle performant. D'après un dicton courant dans le domaine de l'intelligence artificielle, et même dans d'autres domaines de la science des données, on dit : « à données inexactes, résultats erronés ». Heureusement, les ONS détiennent des données de haute qualité qui peuvent être utilisées de manière appropriée et éthique pour entraîner des modèles d'AA de haute qualité (néanmoins, cet article traite uniquement de la confidentialité des données). Cependant, il peut s'avérer difficile d'acquérir des données de qualité sur des sujets de nature délicate ainsi que des données protégées par la loi pour explorer des statistiques sur des domaines précis.

De toutes les techniques d'amélioration de la protection de la vie privée présentées ci-dessus, l'apprentissage fédéré est l'approche qui permet de générer des modèles d'AA avec des données de nature délicate ou protégées par la loi, en supposant que les clients ou les collaborateurs soient d'accord. Le présent article traite de l'apprentissage fédéré et des cas potentiels de son utilisation dans le secteur public lorsque des recherches plus approfondies auront été menées.

Contexte de l'apprentissage fédéré

L'apprentissage fédéré est une technique d'apprentissage distribué qui vise à construire un modèle d'AA central à partir de sources de données distribuées, sans recueillir les données. Les données distribuées utilisées pour l'entraînement du modèle d'AA centralisé qu'une autorité centrale détiendra restent sur les unités périphériques des clients et n'en partent pas. Les réseaux neuronaux sont utilisés pour l'apprentissage fédéré, car ils utilisent des couches de facteurs de pondération numériques pour l'apprentissage qui sont faciles à regrouper et à partager. Dans le cadre du présent article, un client désigne une personne ou une organisation qui détient des données pertinentes qu'elle accepte d'utiliser dans le cadre du processus d'apprentissage fédéré, en collaboration avec l'autorité centrale. Parmi les exemples de clients, citons les participants à une collecte par approche participative qui utilisent leur ordinateur portatif, leur téléphone ou leur tablette et les organisations détenant des données pertinentes. Une autorité centrale fait référence à la personne ou à l'organisation (comme les ONS ou les entreprises privées) responsable de la détention, de la mise à jour et, possiblement, de la distribution du modèle d'AA central, entraînée sur les unités périphériques des clients avant que la collecte des facteurs de pondération du modèle des clients ne soit envoyée pour être regroupée.

Pour utiliser l'apprentissage fédéré afin d'entraîner un modèle d'AA détenu et initialisé par l'autorité centrale, sans visualiser les données d'entraînement du client, le modèle initial devrait d'abord être entraîné avec les données stockées par l'autorité centrale. Ensuite, l'autorité centrale soumettra des demandes à un sous-ensemble de clients pour entraîner le modèle. Si le client peut entraîner le modèle, il envoie le modèle et les instructions pour que son unité périphérique effectue l'entraînement. Les clients entraîneront ensuite le modèle d'AA fourni en utilisant les données stockées sur leur unité périphérique.

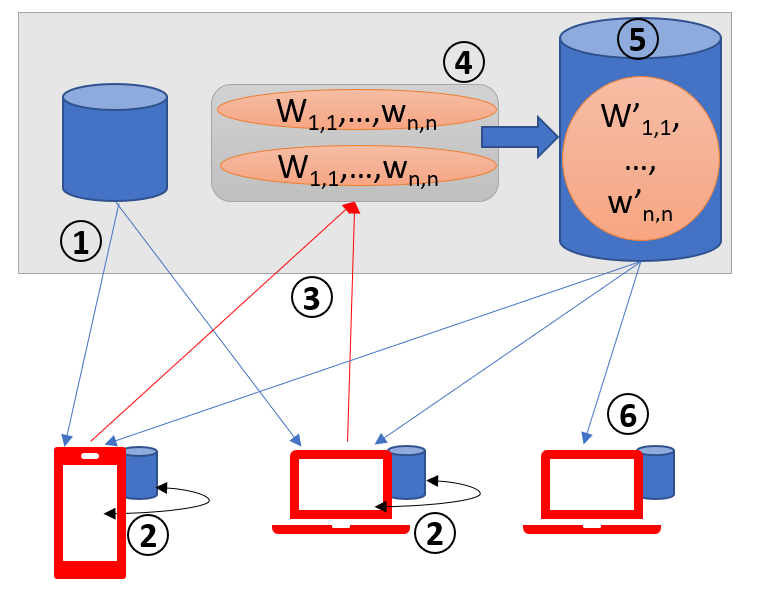

Une fois les modèles entraînés localement, les unités périphériques des clients renverront uniquement les facteurs de pondération du modèle d'AA mis à jour, sans les données utilisées pour l'entraînement. Ces facteurs de pondération sont des nombres ajustés pendant l'entraînement pour en apprendre plus sur les données. L'autorité centrale reçoit ensuite ces facteurs de pondération des clients et les regroupe pour les utiliser comme facteurs de pondération actualisés pour le modèle centralisé. Il en résulte un modèle d'AA entraîné détenu par l'autorité centrale sans recueillir ni apprendre les données détenues par ses clients. Le présent article ne portera pas sur tous les aspects techniques de ce processus ni sur les différentes options offertes, mais je mets en évidence le processus dans la figure ci-dessous.

Figure 1 : Vue d'ensemble du processus d'apprentissage fédéré

Une vue d'ensemble du processus d'apprentissage fédéré. 1) L'autorité centrale dispose d'un modèle qui doit être entraîné. Une demande d'entraînement est fournie à deux clients qui acceptent la demande et reçoivent le modèle. 2) Les unités périphériques des clients utilisent leurs données locales pour entraîner le modèle reçu sur leur unité périphérique. 3) Après l'entraînement, chaque client renvoie ses facteurs de pondération à l'autorité centrale pour un traitement sans les données. 4) L'autorité centrale prend les facteurs de pondération mis à jour et calcule les données regroupées pour mettre à jour le modèle. La valeur w1,1 représente le premier facteur de pondération pour la première couche et la valeur wn,n représente le ne facteur de pondération pour la ne couche. 5) L'autorité centrale utilise les facteurs de pondération actualisés pour mettre à jour le modèle central. 6) Le modèle mis à jour est diffusé aux clients afin qu'ils puissent l'utiliser ou pour faire un entraînement complémentaire. Ce processus est répété au besoin.

Comme pour les autres techniques d'amélioration de la protection de la vie privée, l'apprentissage fédéré dispose de bibliothèques, de sorte que la technique peut être utilisée pour la recherche et la production. Toutefois, il reste encore beaucoup de choses à mettre en œuvre dans ces bibliothèques avant qu'une bibliothèque libre entièrement robuste soit accessible pour la production. D'autres bibliothèques sont créées en permanence, mais même les plus importantes ne sont pas assez sophistiquées pour traiter des problèmes complexes sans de solides compétences en programmation pour compléter les fonctionnalités.

Utilisation de l'apprentissage fédéré pour les organisations

Comme l'apprentissage fédéré permet d'entraîner des réseaux neuronaux dans un environnement distribué sans avoir accès aux données, des projets autrefois impossibles sont désormais envisageables. Un exemple de projet collaboratif de preuve de concept a été présenté au PET Lab des Nations Unies (le laboratoire des techniques d'amélioration de la protection de la vie privée) par divers ONS. Cette preuve de concept explique comment tirer des enseignements à partir de données distribuées sur l'activité physique à l'aide de l'apprentissage fédéré. Ce projet a utilisé et distribué un ensemble de données ouvertes sur l'activité physique parmi les ONS, où chaque ONS considère que ces données sont privées dans le cadre de son projet. Statistique Canada vise à tirer des enseignements à partir des données sur l'activité physique des autres ONS ainsi que de ses propres données privées sur l'activité physique, en construisant un modèle avec des données distribuées sans les recueillir (ce qui atténue les préoccupations juridiques et en matière de confidentialité de chaque ONS). Chaque ONS peut ensuite utiliser le modèle généré à ses propres fins statistiques.

Ce projet a permis de reproduire divers scénarios d'apprentissage fédéré dans lesquels les données distribuées ont généré un modèle détenu par l'autorité centrale sans accéder à aucune des données ni les recueillir. En outre, des expériences comportant l'utilisation d'un chiffrement homomorphe en plus de l'apprentissage fédéré, en chiffrant un sous-ensemble des facteurs de pondération du modèle pour les garder privés, ont également été couronnées de succès dans le cadre du projet.

Cela met en évidence une utilisation claire concernant l'apprentissage fédéré : les organisations qui ne peuvent généralement pas transmettre de données de nature délicate peuvent néanmoins générer des modèles à utiliser à des fins statistiques sans divulguer les données. Cela peut donner l'occasion de réaliser des projets comportant des domaines qui sont de nature délicate ou protégés par la loi et qui ne se produiraient pas autrement, comme certaines collaborations interorganismes. Bien entendu, les ONS et d'autres organisations gouvernementales étudient et expérimentent soigneusement les techniques d'amélioration de la protection de la vie privée et leurs faiblesses avant de prendre des mesures pour rendre ces techniques opérationnelles. Nous y reviendrons plus tard.

Une autre utilisation potentielle des techniques d'amélioration de la protection de la vie privée dans le cadre d'un ONS est celle des activités de collecte par approche participative. Cependant, pour certains sujets, les participants peuvent être réticents à fournir des renseignements, quelle que soit l'incitation. Par conséquent, en offrant une application ou une page Web sécurisée où les utilisateurs peuvent participer sans partager de données, le nombre d'utilisateurs qui hésitent à participer peut être moindre. Il reste néanmoins des défis à déterminer et à anticiper avant de pouvoir mettre en œuvre ces techniques, comme les attaques possibles et les stratégies de communication.

Les défis de l'apprentissage fédéré

Si l'apprentissage fédéré et les autres techniques d'amélioration de la protection de la vie privée peuvent sembler être des outils magiques capables de résoudre tous les problèmes majeurs en matière de protection de la vie privée, il y a des défis à prendre en compte. Une seule technique d'amélioration de la protection de la vie privée ne permet pas d'atténuer complètement tous les risques liés à la protection de la vie privée, mais fournira des mesures d'atténuation supplémentaires permettant de réaliser des projets qui seraient autrement impossibles. Les techniques d'amélioration de la protection de la vie privée à utiliser et la stratégie de communication qui explique la façon dont les données d'un client restent privées sont essentielles et varieront en fonction de chaque cas d'utilisation.

Les techniques d'amélioration de la protection de la vie privée font l'objet de recherches actives, et de nombreuses attaques et défenses contre les techniques d'amélioration de la protection de la vie privée sont à l'étude. Les attaques traditionnelles contre les modèles d'AA peuvent toujours être mises en œuvre contre certaines techniques d'amélioration de la protection de la vie privée et nécessitent toujours des défenses, ce qui fait que la technique d'amélioration de la protection de la vie privée agit comme une mesure de protection de la vie privée supplémentaire qui nécessite toujours des défenses contre les attaques. Par exemple, une attaque par inférence d'appartenance peut être effectuée pour déterminer si des données ont été utilisées pour entraîner un modèle. Comme l'apprentissage fédéré combine les facteurs de pondération des modèles recueillis auprès des clients, il y a un degré de défense supplémentaire contre certaines attaques, mais il existe des scénarios où les attaques peuvent encore être efficaces contre le modèle centralisé. Les ONS enquêtent sur ces questions afin de déterminer comment atténuer les attaques et se préparer à rendre les techniques d'amélioration de la protection de la vie privée opérationnelles en toute sécurité à l'avenir.

S'il existe des bibliothèques de programmation accessibles pour utiliser l'apprentissage fédéré, toutes ne sont pas prêtes à être utilisées dans des systèmes de production sans avoir de défis à relever ou en utilisant des logiciels payants (qui peuvent encore ne pas inclure toutes les fonctionnalités nécessaires à un cas d'utilisation). Par conséquent, l'un des principaux défis à relever par la communauté des techniques d'amélioration de la protection de la vie privée sera de continuer à développer des logiciels libres que les personnes ou les organisations pourront utiliser facilement et en toute confiance, au-delà des contextes de simulation.

Le dernier défi central à évoquer est celui des stratégies de communication entourant l'utilisation de l'apprentissage fédéré. Lorsque les organisations collaborent au moyen de l'apprentissage fédéré, elles peuvent procéder à un audit du code base et participer à son développement pour s'assurer qu'il est correctement mis en œuvre et qu'il peut être utilisé en toute sécurité avec leurs données. Il est donc plus facile à utiliser dans le cadre de collaborations professionnelles où des experts sont disponibles pour évaluer et développer les systèmes. Cependant, dans un cadre public, l'histoire est tout à fait différente. Chaque client devra être convaincu que l'approche fonctionne et que ses données ne quitteront jamais réellement son unité périphérique. Étant donné les difficultés générales entourant la confiance entre les utilisateurs et les organisations, il s'agit d'un obstacle important que les communautés et les organisations chargées des techniques d'amélioration de la protection de la vie privée devront surmonter.

Conclusions

L'apprentissage fédéré est un outil important qui peut conduire à des occasions qui ne sont pas possibles autrement. En générant des modèles d'AA sans avoir accès aux données utilisées pour l'entraînement, les ONS peuvent fournir au public des renseignements qu'il serait impossible de fournir autrement. Cette technique est actuellement utilisée par des organisations privées et fait l'objet de recherches actives. Les ONS étudient les techniques d'amélioration de la protection de la vie privée dans l'intention de favoriser les collaborations à l'échelle mondiale qui peuvent apporter un avantage à la société dans son ensemble. Ce travail de recherche peut également s'étendre à d'autres organisations publiques et permettre davantage de collaborations interorganismes au sein de la fonction publique. Bien qu'il reste encore beaucoup de travail à faire à Statistique Canada avant de rendre fonctionnel l'apprentissage fédéré, la poursuite de nos recherches permettra d'améliorer la protection de la vie privée et de produire davantage de statistiques.

L'apprentissage fédéré présente de nombreux défis qui doivent être relevés, mais les ONS et les communautés internationales des techniques d'amélioration de la protection de la vie privée continueront à collaborer et à utiliser la technique de manière sûre et efficace, en maintenant la protection de la vie privée au premier plan de toutes les initiatives. Chaque technique d'amélioration de la protection de la vie privée fera l'objet d'une analyse des attaques afin de prouver qu'il s'agit d'une méthode de protection de la vie privée solide. Tout cela devra être clairement communiqué au public et aux autres organisations.

Rencontre avec le scientifique des données

Si vous avez des questions à propos de mon article ou si vous souhaitez en discuter davantage, je vous invite à une Rencontre avec le scientifique des données, un événement au cours duquel les auteurs rencontrent les lecteurs, présentent leur sujet et discutent de leurs résultats.

Jeudi, le 15 décembre

14 h 00 à 15 h 00 HE

MS Teams – le lien sera fourni aux participants par courriel

Inscrivez-vous à la présentation Rencontre avec le scientifique des données. À bientôt !

Ressources additionnelles

- Date de modification :